Große Sprachmodelle (Large Language Models, LLMs) sind eine Art von künstlicher Intelligenz (KI). LLMs werden aktiv für das Lesen von Text und das Verstehen von Sprache als Daten trainiert. Ihre Modelle ermöglichen ihnen das Verständnis von kontextreichen Informationen und die Erstellung von Text (oder Sprache), der sich anhört, als stamme er von einem Menschen.

Wie funktionieren LLMs?

Große Sprachmodelle lernen, was die von ihnen gelesenen Daten bedeuten. Anschließend nutzen LLMs die Fähigkeiten des Deep Learning und der Datenanalyse, um Antworten auf Fragen zu formulieren, Übersetzungen anzubieten und neue Inhalte auf der Grundlage des Gelernten zu schreiben. Bei den großen Sprachmodellen handelt es sich sowohl um Open-Source-Modelle (wie LLaMa und BLOOM) als auch um proprietäre LLMs (wie Claude und GPT). Sie arbeiten mit vier miteinander verbundenen, symbiotischen Ebenen, mit denen sie Wörter erkennen und deren Bedeutung bestimmen. Jede Ebene spielt bei der Verarbeitung des Dateninputs und der Erzeugung des Outputs eine bestimmte Rolle.

Hier ein Beispiel: Eine Person fragt Google Gemini: „Hilf mir, einen Notdienst in meiner Nähe zu finden, der jetzt geöffnet ist."

Die Einbettungsebene prüft die rohe Bedeutung der einzelnen Wörter und sortiert sie in Vektoren oder numerische Datensätze. So könnten beispielsweise „Notdienst" und „offen" als unterschiedliche Datensätze sortiert werden.

Die Feedforward-Ebene untersucht die einzelnen Wörter aus allen Blickwinkeln und berücksichtigt dabei die Komplexität ihrer Bedeutung. So könnte zum Beispiel „Notdienst" als „nicht lebensbedrohlich" verstanden werden.

Der Aufmerksamkeitsmechanismus versteht die kontextuellen Beziehungen zwischen den Wörtern. Er kann beurteilen, welche Wörter am wichtigsten sind. So könnte zum Beispiel „jetzt geöffnet" höher gewichtet als „in meiner Nähe" werden.

Die rekurrente Ebene erinnert sich und verwendet frühere Eingaben zur Verarbeitung der Informationen und Präsentation von Antworten. Zum Beispiel: „Hier ist eine Karte mit den nächstgelegenen medizinischen Einrichtungen in Ihrer Nähe, die jetzt geöffnet haben. Wenn Sie einen lebensbedrohlichen Notfall haben, wählen Sie 112."

Was ist RAG und wie wird sie von LLMs genutzt?

RAG, oder Retrieval-Augmented Generation, schließt die Lücke zwischen dem, was ein LLM weiß und dem, was es entdecken kann. LLMs verfügen über grundlegendes Wissen, das auf Trainingsdaten basiert. Und mithilfe von RAG können LLMs in Echtzeit aus neuen Datenquellen lernen. Mit dieser Fähigkeit, neue (oder „erweiterte") Informationen abzurufen, können LLMs die genauesten, aktuellsten und zuverlässigsten Informationen generieren.

Da LLMs auf statischen (oder möglicherweise veralteten) Daten trainieren, verfügen sie möglicherweise nicht über die neuesten Informationen. Mithilfe von RAG können LLMs die genauesten und aktuellsten Antworten abrufen und bereitstellen. Außerdem kann RAG seine Quellen angeben, was für Transparenz sorgt und Vertrauen schafft.

Wie LLMs die Suche und Markensichtbarkeit beeinflussen

Mit der zunehmenden Nutzung von KI-Suchergebnissen wächst auch das Vertrauen der Kund*innen in die KI-Suche. Sie schätzen die direkten, dialogorientierten Antworten, die LLMs bieten (anstelle der traditionellen SERPs, die mit stichwortbasierten Links gefüllt sind, die Kund*innen auf der Suche nach Antworten durchsuchen müssen).

Marken und digitale Marketingfachkräfte müssen weniger über einzelne Stichwörter nachdenken und mehr darüber, wie sie zur ersten Anlaufstelle für Ihren Themenbereich werden.

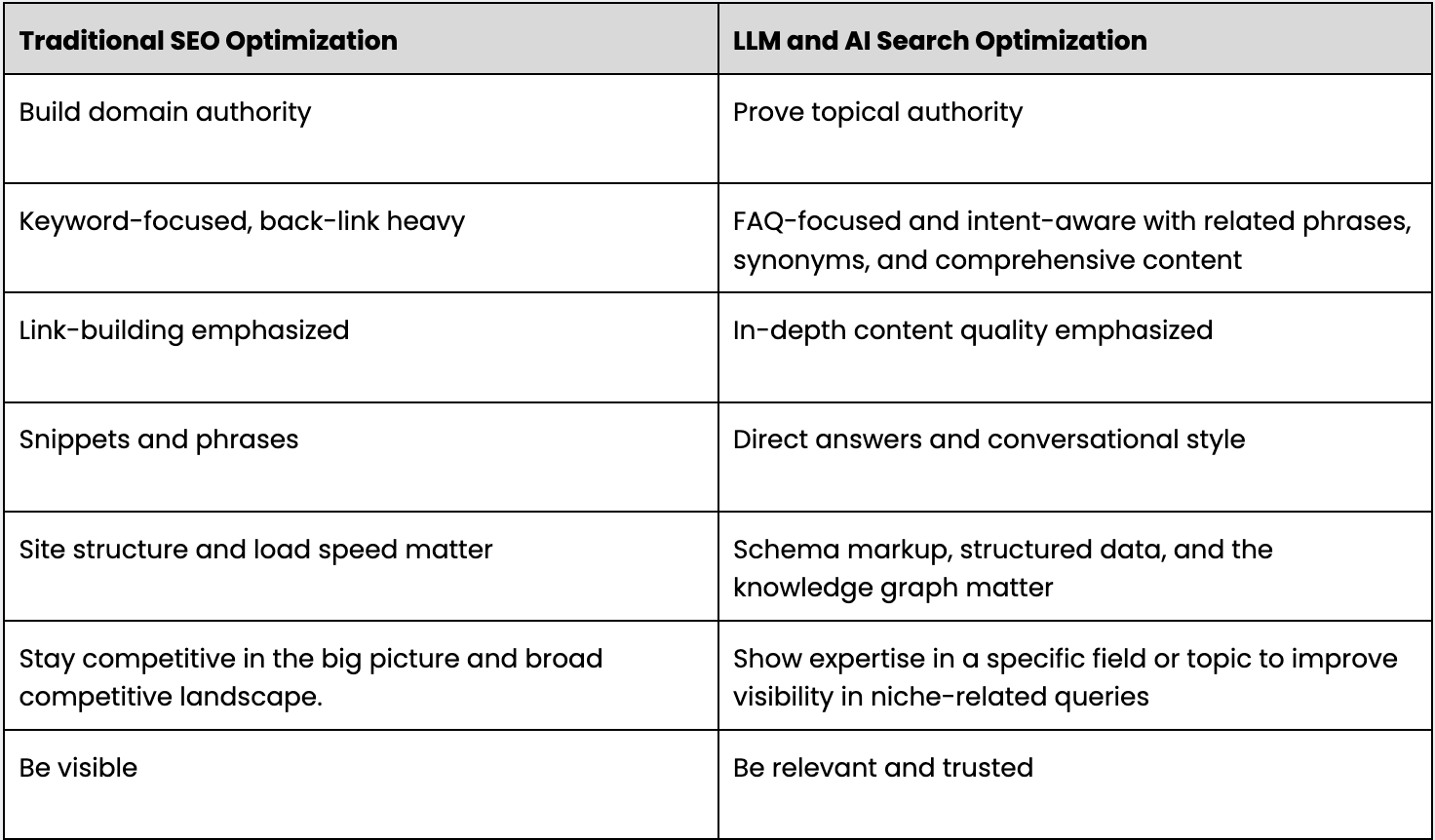

Optimierung für traditionelle SEO vs. Optimierung für Auffindbarkeit in LLMs

Bei der traditionellen SEO ging es um den Aufbau von Domain-Autorität (die allgemeine Stärke und Vertrauenswürdigkeit Ihrer Website als Ganzes). Modernes SEO hat sich dahingehend verändert, dass es auch den Aufbau thematischer Autorität umfasst (d. h. die Anerkennung als Expert*in in einem bestimmten Themenbereich aufgrund Ihrer größeren digitalen Präsenz).

Um für LLMs zu optimieren und in der KI-Suche sichtbar zu bleiben, gibt es neue Regeln. Ihre Sichtbarkeitsstrategien müssen über die alten SEO-Spielregeln hinausgehen und sich weiterentwickeln. LLMs interessiert es nicht, wie viele Backlinks Sie haben. Sie interessieren sich vielmehr dafür, wie gut, nützlich und zugänglich Ihre Inhalte sind.

Hier ist eine Vergleichstabelle, die Ihrer Marke hilft, sowohl für traditionelle Suchmaschinen als auch für LLM- oder KI-gestützte Sucherlebnisse erfolgreich zu optimieren:

Mit der Zunahme und Verbesserung generativer Suchergebnisse verschieben sich die SERP- und Ranking-Signale

Mit LLMs und KI-gestützten Sucherlebnissen ist es nicht das Ziel, SEO oder KI-Plattformen auszutricksen. Stattdessen geht es darum, jeder KI-Plattform das gesamte strukturierte Wissen zur Verfügung zu stellen, das sie zur Erkennung von Suchintentionen benötigt. Daraufhin können sie den Kund*innen mit den Informationen antworten, die sie für die Fortsetzung ihrer Customer Journey benötigen.

Deshalb müssen Marken jetzt ihre Strategien für Branding, digitales Marketing und Content mit ihrer Datenstrategie in Einklang bringen.

Vorbereitung Ihrer Content- und Datenstrategie für LLMs und KI-Suche

Hier sind sechs Tipps zur Anpassung Ihrer Inhalte und Ihrer Strategie für LLMs und die KI-gestützte Suche:

Prüfung Ihrer Inhalte. Beurteilen Sie, wie gut Ihre vorhandenen Inhalte häufige Kundenfragen beantworten, die in allen Ihren digitalen Kanälen auftauchen.

Strukturierung von Inhalten rund um FAQs. Nutzen Sie die Daten aus Ihrem Audit, um die Fragen der Kund*innen entlang der gesamten Customer Journey direkt zu beantworten.

Optimierung für die Sprachsuche. Erstellen Sie Inhalte auf der Grundlage dessen, was Sie darüber gelernt haben, wie Nutzer*innen Suchanfragen mündlich formulieren. Achten Sie darauf, welche Arten von Fragen von ihnen aneinandergereiht werden.

Erstellung von umfassenden Leitfäden (und Verbreitung von Inhalten in mundgerechten Formaten). Entwickeln Sie ausführliche, kompetente Inhalte, die Themen umfassend abdecken.

Fortlaufende Konzentration auf E-E-A-T. Betonen Sie weiterhin Ihre Kompetenz, Erfahrung, Autorität und Vertrauenswürdigkeit (Expertise, Experience, Authoritativeness, Trustworthiness) in Ihren Inhalten. Dies wird nie an Bedeutung verlieren.

Aufbau eines Wissensgraphen mit strukturierten Daten. Ein Wissensgraph bildet die Grundlage für die Zentralisierung und gemeinsame Nutzung Ihrer Markeninformationen über alle digitalen Kanäle hinweg. Mit dem Wissensgraphen bleiben Ihre Daten organisiert, genau und zusammenhängend. Marken wiederum nutzen den Wissensgraphen, um die Einheitlichkeit ihrer Inhalte zu verbessern, die Sichtbarkeit zu erhöhen und Vertrauen über alle Berührungspunkte hinweg aufzubauen.