I modelli linguistici di grandi dimensioni (LLM) sono un tipo di intelligenza artificiale (IA). Gli LLM sono addestrati attivamente per leggere il testo e comprendere il parlato come dati. I loro modelli li aiutano a comprendere informazioni ricche di contesto e a creare testo (o voce) che sembra provenire da un essere umano.

Come funzionano gli LLM?

I modelli linguistici di grandi dimensioni apprendono il significato dei dati che leggono. Quindi, gli LLM utilizzano le capacità di deep learning e analisi dei dati per formulare risposte alle domande, offrire traduzioni e scrivere nuovi contenuti in base a ciò che hanno appreso. I modelli linguistici di grandi dimensioni possono essere sia open source (come LLaMa e BLOOM) che proprietari (come Claude e GPT). Operano su quattro livelli interconnessi e simbiotici che li aiutano a riconoscere le parole e a dare loro un significato. Ogni livello svolge un ruolo specifico nell'elaborazione dei dati in ingresso e nella generazione dell'output.

Ecco un esempio: un cliente chiede a Google Gemini, "Aiutami a trovare un UrgentCare aperto in questo momento vicino a me."

Il livello di incorporamento esamina il significato non elaborato delle singole parole e le ordina in vettori o tipi numerici di set di dati. Es. "urgente" e "aperto" potrebbero essere ordinati come set di dati diversi.

Il livello feedforward esamina le singole parole da tutti i punti di vista, tenendo conto della complessità del loro significato. Es. "cure urgenti" potrebbe essere inteso come "non in pericolo di vita."

Il meccanismo di attenzione comprende le relazioni contestuali tra le parole. Può esprimere giudizi su quali parole sono più importanti. Ad esempio: potrebbe dare più importanza a "aperto ora" rispetto a "vicino a me".

Il livello ricorrente ricorda e utilizza gli input passati per elaborare le informazioni e presentare le risposte. Es. "Ecco una mappa che mostra i centri di assistenza medica non di emergenza più vicini, attualmente aperti nella tua zona. In caso di emergenza di morte, chiama il 911."

Che cos'è il RAG e come lo usano gli LLM?

La RAG, o Retrieval-Augmented Generation, colma il divario tra ciò che un LLM conosce e ciò che può scoprire. Gli LLM hanno conoscenze di base a partire dai dati di addestramento e, con la RAG, possono apprendere da nuove fonti di dati in tempo reale. Questa capacità di recuperare informazioni nuove, o "aumentate", aiuta gli LLM a generare le informazioni più accurate, aggiornate e affidabili disponibili.

Poiché gli LLM vengono addestrati su dati statici (o che potrebbero diventare obsoleti), potrebbero non disporre delle informazioni più recenti. La RAG consente agli LLM di recuperare e fornire le risposte più accurate e aggiornate. La RAG può anche citare le sue fonti, garantendo trasparenza e rafforzando fiducia.

In che modo gli LLM influiscono sulla ricerca e sulla visibilità del brand

Man mano che i clienti utilizzano sempre più le esperienze di ricerca con l'IA, aumenta anche la fiducia dei clienti in questi strumenti. I clienti apprezzano le risposte dirette e conversazionali offerte dagli LLM (invece delle tradizionali SERP piene di link basati su parole chiave che i clienti devono setacciare per trovare le risposte).

I brand e i professionisti del marketing digitali devono concentrarsi meno sulle singole parole chiave e più sul diventare la risorsa di riferimento per la propria area tematica.

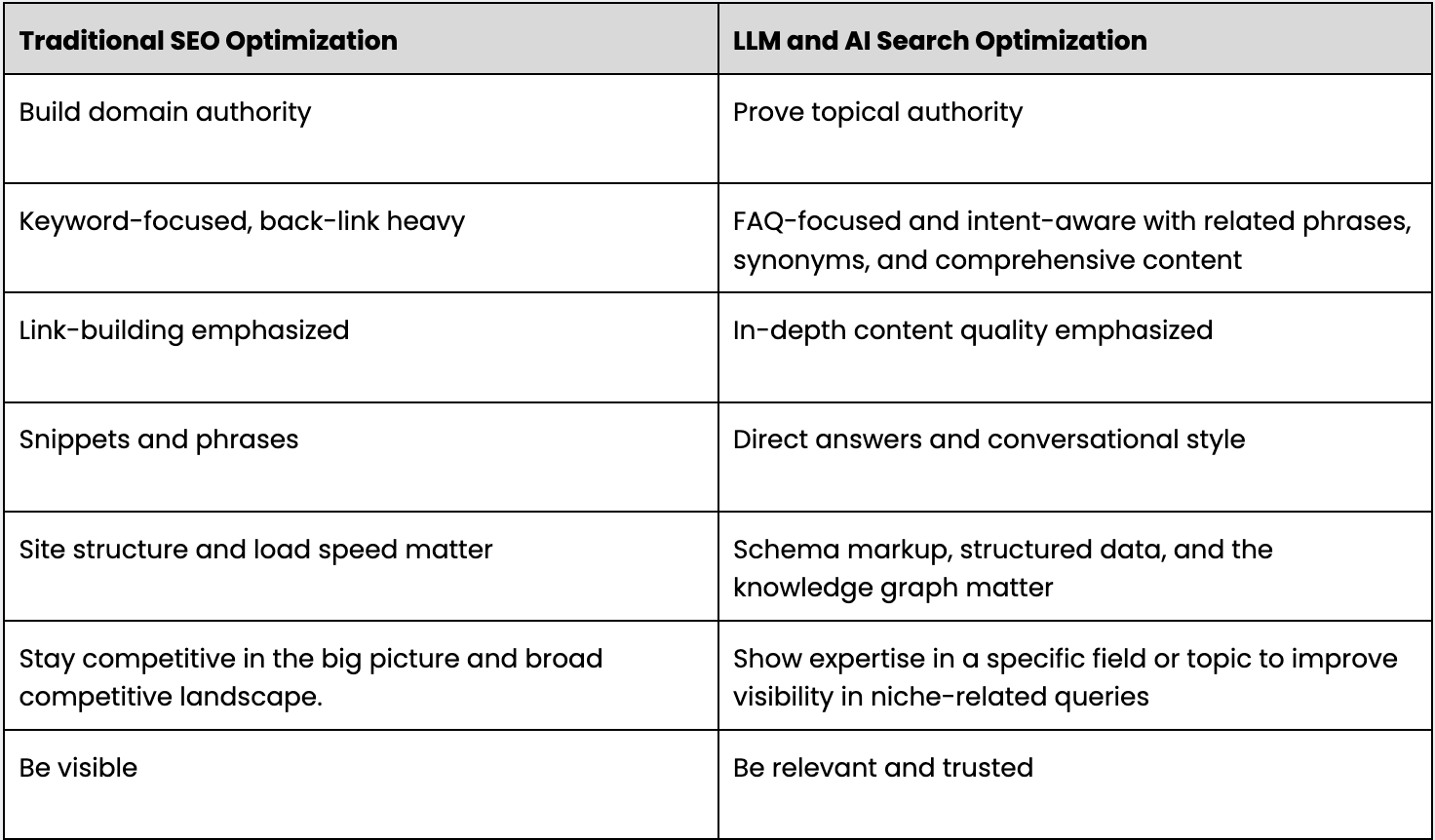

Confronto tra l'ottimizzazione per la SEO tradizionale e l'ottimizzazione per la visibilità negli LLM

La SEO tradizionale era incentrata nello stabilire autorevolezza di dominio (la potenza e l'affidabilità complessive del tuo sito web nel suo insieme). La SEO moderna si è evoluta fino a includere la creazione di un'autorevolezza tematica (essere riconosciuti come esperto in un'area tematica specifica grazie alla propria presenza digitale più ampia).

Per ottimizzare per gli LLM e rimanere visibili nella ricerca basata sull'IA, ci sono nuove regole. Le tue strategie di visibilità devono evolversi rispetto al vecchio manuale SEO. Agli LLM non importa quanti backlink hai, ma della qualità, utilità e accessibilità dei tuoi contenuti.

Ecco una tabella comparativa per aiutare il tuo brand ad ottenere successo nell'ottimizzazione sia per i motori tradizionali che per le esperienze di ricerca basate su LLM o IA:

Man mano che i risultati di ricerca generativi aumentano e migliorano, i segnali SERP e di posizionamento stanno cambiando

Con gli LLM e le esperienze di ricerca basate sull'IA, l'obiettivo non è manipolare le piattaforme SEO o IA. Ma piuttosto fornire a ogni piattaforma di IA tutte le conoscenze strutturate necessarie per riconoscere l'intento di ricerca e poi rispondere ai clienti con le informazioni di cui hanno bisogno per continuare il loro percorso del cliente.

Ecco perché i brand devono allineare le loro strategie di brand, marketing digitale e contenuti con la loro strategia dei dati.

Preparare la tua strategia di contenuti e dati per LLM e ricerca basata sull'IA

Ecco sei consigli per adattare i tuoi contenuti e la tua strategia agli LLM e alla ricerca guidata dall'IA:

Esegui un controllo dei tuoi contenuti. Valuta quanto efficacemente i tuoi contenuti esistenti rispondono alle domande più comuni dei clienti che appaiono su tutti i tuoi canali digitali.

Struttura il contenuto in base alle FAQ. Usa i dati del tuo controllo per rispondere direttamente alle domande dei clienti lungo il loro percorso.

Ottimizza per la ricerca vocale. Crea contenuti basati su ciò che hai imparato sul modo in cui gli utenti formulano verbalmente le query. Nota i tipi di domande che i clienti mettono insieme.

Crea guide complete (e distribuisci i contenuti anche in formati ridotti). Sviluppa contenuti approfonditi e autorevoli che trattino gli argomenti in modo esaustivo.

Continua a concentrarti sul framework E-E-A-T. Continua a mettere in risalto esperienza, competenza, autorevolezza e affidabilità nei tuoi contenuti, rimane fondamentale

Utilizza un grafo di conoscenza con dati strutturati. Un grafo di conoscenza costituisce la base per centralizzare e condividere le informazioni del tuo brand attraverso tutti i canali digitali. Il grafo di conoscenza mantiene i tuoi dati organizzati, accurati e interconnessi. A sua volta, i brand utilizzano il grafo di conoscenza per migliorare la coerenza dei contenuti, aumentare la visibilità e rafforzare la fiducia in ogni punto di contatto.