Les grands modèles de langage (LLM) constituent un type d'intelligence artificielle (IA). Ils sont activement entraînés à lire des textes et à comprendre la parole en tant que données. Leurs modèles les aident à comprendre des informations riches en contexte et à créer un texte (ou un discours oral) qui semble provenir d'un être humain.

Comment les grands modèles de langage fonctionnent-ils ?

Les grands modèles de langage apprennent ce que signifient les données qu'ils lisent. Ensuite, ils s'appuient sur l'apprentissage profond et l'analyse de données pour formuler des réponses aux questions, proposer des traductions et rédiger de nouveaux contenus sur la base de ce qu'ils ont appris. Les grands modèles de langage peuvent être open source (comme LLaMa ou BLOOM) et propriétaires (comme Claude et GPT). Ils fonctionnent sur quatre couches interconnectées et symbiotiques qui les aident à reconnaître les mots et à en comprendre le sens. Chaque couche joue un rôle spécifique dans le traitement des données ingérées et la production des résultats.

Voici un exemple : un client demande à Google Gemini "Aide-moi à trouver un centre de soins d'urgence ouvert maintenant à proximité."

La couche d'intégration examine le sens brut des mots individuels et les classe en vecteurs ou en types numériques de jeux de données. Par exemple, "urgence" et "ouvert" peuvent être identifiés dans des jeux de données distincts.

La couche d'anticipation examine chaque mot sous tous les angles, en tenant compte de la richesse de son sens. Par exemple, "soins d'urgence" peut être compris comme "non vital".

Le mécanisme d'attention comprend les relations contextuelles entre les mots. Il peut juger de l'importance des mots les uns par rapport aux autres. Par exemple, il peut choisir d'accorder plus d'importance à "ouvert maintenant" qu'à "à proximité".

La couche récurrente mémorise et exploite les données antérieures pour traiter les informations et présenter des réponses. Par exemple, "Voici une carte indiquant les centres de soins médicaux les plus proches et ouverts actuellement pour les urgences non vitales. En cas d'urgence vitale, composez le 15".

Qu'est-ce que la RAG et comment les LLM l'utilisent-ils ?

La RAG, ou génération augmentée par récupération, fait le lien entre ce qu'un LLM sait et ce qu'il peut découvrir. Les LLM disposent de connaissances de base fondées sur des données d'entraînement, et grâce à la RAG, ils peuvent intégrer en temps réel des informations issues de nouvelles sources de données. Cette capacité à obtenir des informations nouvelles ou enrichies aide les LLM à générer des résultats parmi les plus précis, à jour et fiables qui soient.

Étant donné que les LLM s'entraînent sur des données statiques (ou susceptibles de devenir obsolètes), ils peuvent ne pas disposer des informations les plus récentes. La RAG permet aux LLM de récupérer et de fournir les réponses les plus précises et les plus à jour. Elle peut également citer ses sources, ce qui favorise la transparence et la confiance.

L'influence des LLM sur la visibilité de la marque et la recherche en ligne

La confiance des clients dans la recherche basée sur l'IA grandit à mesure que leurs expériences de cet outil se multiplient. Ils apprécient les réponses directes et conversationnelles proposées par les LLM (par opposition aux moteurs de recherche traditionnels, qui regorgent de liens fondés sur des mots-clés qu'il faut parcourir pour trouver des réponses).

Il est primordial que les marques et les spécialistes du marketing numérique accordent moins d'importance aux mots-clés pris isolément et deviennent des sources d'information incontournables dans leur domaine.

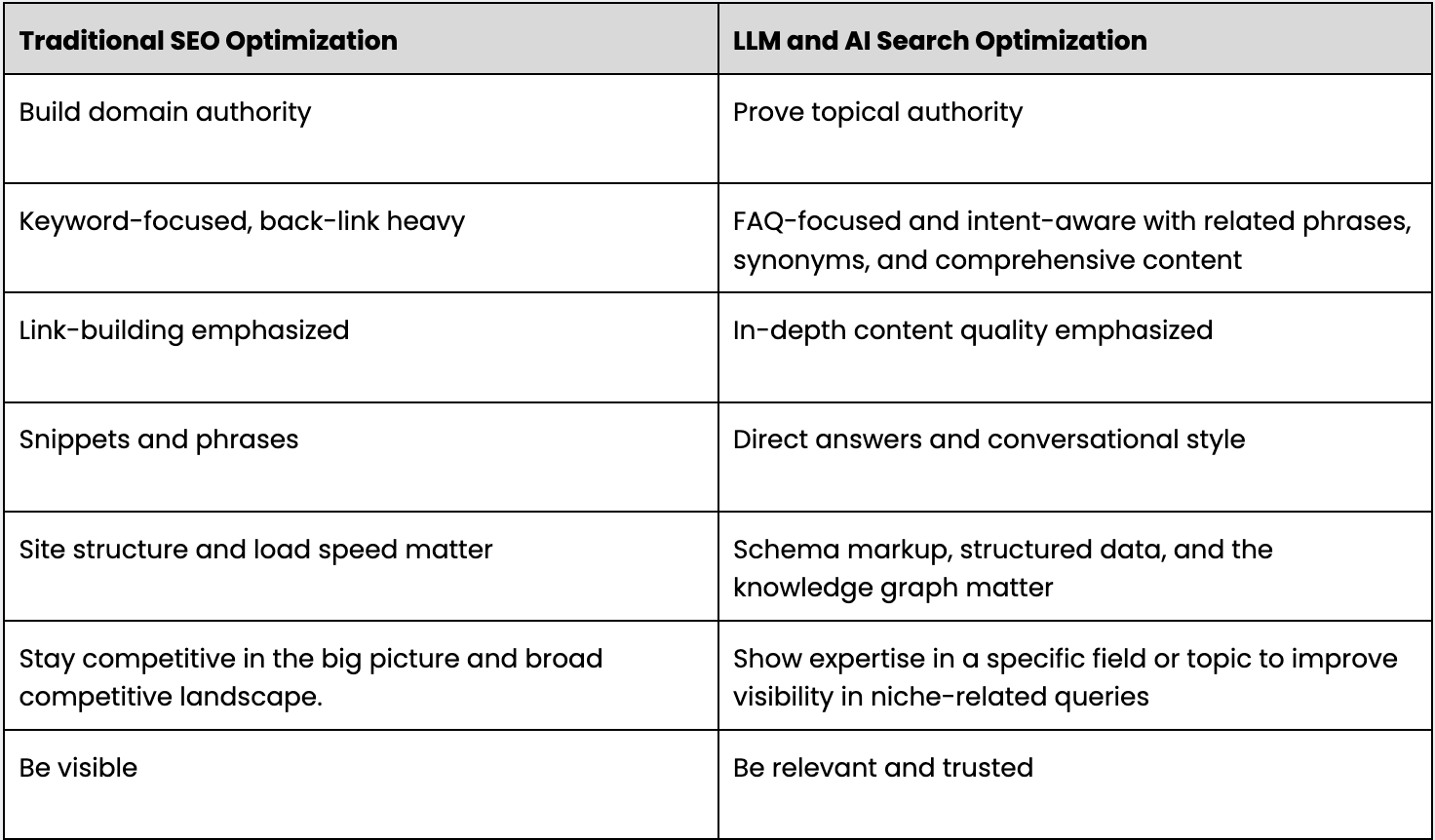

Optimiser le SEO traditionnel vs optimiser la visibilité dans les LLM

Le SEO traditionnel s'est historiquement construit autour de l'établissement de la légitimité du domaine (la puissance et la fiabilité de votre site Internet dans son ensemble). Le référencement moderne a évolué pour valoriser une légitimité thématique (être reconnu comme spécialiste d'un domaine spécifique grâce à une présence numérique plus étendue).

Pour optimiser le contenu par rapport aux LLM et rester visible dans les recherches basées sur l'IA, il faut suivre de nouvelles règles. Vos stratégies de visibilité doivent s'affranchir des anciennes méthodes de SEO. Les LLM accordent peu d'importance au nombre de backlinks que vous avez. Ce qui leur importe, c'est la qualité, l'utilité et l'accessibilité de votre contenu.

Ce tableau comparatif guidera l'optimisation des contenus de votre marque à la fois pour les moteurs traditionnels et pour les expériences de recherche basées sur des LLM ou l'IA :

À mesure que les résultats de recherche génératifs augmentent et s'améliorent, les SERP et les signaux de classement évoluent

Avec les LLM et les expériences de recherche basées sur l'IA, l'idée n'est pas de manipuler le SEO ou les plateformes d'IA. L'objectif est plutôt de fournir à toutes les plateformes d'IA l'ensemble des connaissances structurées dont elles ont besoin pour reconnaître l'intention de recherche et donner aux clients les informations qu'il leur faut pour poursuivre leur parcours client.

C'est pourquoi les marques doivent désormais aligner leurs stratégies de marque, de marketing numérique et de contenu avec leur stratégie de données.

Adapter votre stratégie de contenu et de données aux LLM et à la recherche par IA

Voici six conseils pour optimiser votre contenu et votre stratégie en fonction des LLM et de la recherche par IA :

Auditez votre contenu. Évaluez dans quelle mesure votre contenu existant répond aux questions les plus fréquemment posées par les clients sur tous vos canaux numériques.

Structurez le contenu autour des questions fréquentes. Utilisez les données de votre audit pour répondre directement aux questions des clients tout au long de leur parcours.

Optimisez votre contenu pour la recherche vocale. Découvrez comment les utilisateurs formulent leurs requêtes à l'oral et adaptez votre contenu en conséquence. Prenez note du type de questions que vos clients posent les unes à la suite des autre.

Créez des guides complets (mais proposez aussi ce contenu sous des formats plus concis). Produisez un contenu approfondi, faisant autorité, qui couvre les sujets abordés de façon exhaustive.

Ne perdez pas de vue les critères E-E-A-T. Continuez à mettre en avant votre expertise, votre expérience, votre autorité et votre fiabilité. Ce sont des éléments qui vous définissent.

Générez un graphe de connaissances avec des données structurées. Un graphe de connaissances constitue la base pour centraliser et partager les informations de votre marque sur tous les canaux numériques. Il permet de veiller à ce que vos données restent organisées, précises et interconnectées. Les marques utilisent quant à elles le graphe de connaissances pour améliorer la cohérence de leur contenu, accroître leur visibilité et instaurer la confiance à chaque point de contact.